信息论(英语:information theory)是应用数学、电子学和计算机科学的一个分支,涉及信息的量化、存储和通信等。信息论是由克劳德·香农发展,用来找出信号处理与通信操作的基本限制,如数据压缩、可靠的存储和数据传输等。自创立以来,它已拓展应用到许多其他领域,包括统计推断、自然语言处理、密码学、神经生物学、进化论和分子编码的功能、生态学的模式选择、热物理、量子计算、语言学、剽窃检测、模式识别、异常检测和其他形式的数据分析。

熵是信息的一个关键度量,通常用一条消息中需要存储或传输一个符号的平均比特数来表示。熵衡量了预测随机变量的值时涉及到的不确定度的量。例如,指定掷硬币的结果(两个等可能的结果)比指定掷骰子的结果(六个等可能的结果)所提供的信息量更少(熵更少)。

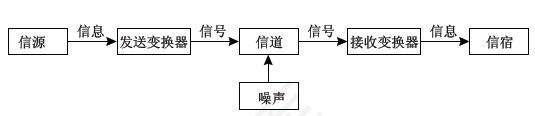

信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法。信息传输和信息压缩是信息论研究中的两大领域。这两个方面又由信道编码定理、信源-信道隔离定理相互联系。

信息论的基本内容的应用包括无损数据压缩(如ZIP文件)、有损数据压缩(如MP3和JPEG)、信道编码(如数字用户线路(DSL))。这个领域处在数学、统计学、计算机科学、物理学、神经科学和电机工程学的交叉点上。信息论对航海家深空探测任务的成败、光盘的发明、手机的可行性、互联网的发展、语言学和人类感知的研究、对黑洞的了解,以及许多其他领域都影响深远。信息论的重要子领域有信源编码、信道编码、算法复杂性理论、算法信息论、资讯理论安全性和信息度量等。1

- 信息产生

- 在面对大量信息时,排除噪音,提取利用有效信息,科学做决 策的能力;

- 信息传播

- 向外界传递信息时,平衡分配有限资源,增加沟通带宽,放大 影响力的能力;

- 信息应用

- 看懂信息应用的逻辑和通信发展的趋势,提前抓住新机遇的能力。

探索三件事:

- 我们现在的位置

- 我们的目标

- 以及通向目标的道路

信息很重要

- 信息很重要,甚至比钱更重要,它能四两拨千斤。而信息作用的大小和信息量 有关。

- 信息量和不确定性有关,大家都知道的事,就没有什么信息量了。

- 对一个未知系统(黑盒子)所作出的估计和真实情况的偏离,就是信息的损失, 偏离越多损失越大。